新着情報

1. Neural Networkの歴史

ニューラル・ネットワークの歴史

ディープ・ラーニング( Learning)は生物の脳をモデルとするニューラル・ネットワークを基礎としている。ここでは、ニューラル・ネットワークの歴史 についての概略をメモにする。

中枢神経組織のモデルとして過去においてはゴルジ染色法を発見したカミッロ・ゴルジ(Camillo Golgi)らが提唱した網状説とカハールが提唱するニューロン説があった。スペインの病理学者サンチァゴ・ラモン・イ・カハール(Santiago Ramon y Cajal: 1852-1934)は、ゴルジ染色法を用いた神経組織標本の観察に基づき、中枢神経はニューロンという非連続な細胞で構成され、シナプスという接合部により互いに連絡するというニューロン説を提唱した。

網状説のゴルジとニューロン説のカハールは神経系の構造研究によりノーベル生理学・医学賞を共同受賞している(1906)。その後、電子顕微鏡の発明により、個々のニューロンの細胞膜は互いに独立していることが確かめられ、現在ではニューロン説が神経科学における基本的な概念となっている。

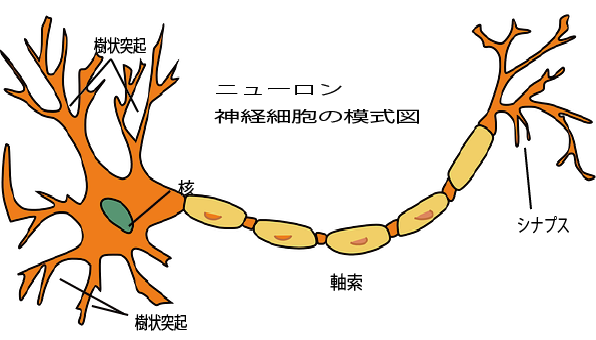

Fig.1 神経細胞(ニューロン: neuron)の模式図。ニューロンは軸索の先端にあるシナプスを通して他のニューロンの樹状突起に情報を伝達する。Free vector graphics of Axon by pixaboy.

第1期(1940年から1970年):

ワレン・マカロック(Warren Sturgis McCulloch)とウォルター・ピッツ(Walter J. Pitts)が生物の神経細胞をモデルにした形式ニューロン・モデルを1943年に発表した。このモデルはマカロックとピッツの素子モデルと呼ばれ、抵抗などの素子を用いた物理的回路網で実現された。

フランク・ローゼンバット(Frank Rosenblatt)が計算機でニューロンの結合重みを学習により決めるパーセプトロン(perceptron: 1958)を発表した。この時、ブームは絶頂を迎えたが、人工知能の父と呼ばれるマービン・リー・ミンスキー (Marvin Lee Minsky) とシーモア・パパート(Seymour Papert)が単純パーセプトロンは線形分離できないパターンを識別できないことを証明した。このため、1950年代の第1期のニューラル・ネットワーク研究のブームは終了した。

第2期(1980年から1990年):

K. FukushimaとS. Miyake による生物の視覚神経回路を模倣したネオコグ二トロンを提案(1980)があった。

ジョン・ホップフィールド(John Joseph Hopfield、1933年7月15日 – )は、ホップフィールドモデル(連想記憶型のニューラル・ネットワーク)を提案(1982)した。

デビッド・ラメルハート(David E. Rumelhart, 1942 – 2011)ら(1986)が誤差伝播法(back propagation)を提案した。これが契機となり、パーセプトロンを階層的に組み合わせる事で線形分離不可能なパターンを識別可能になり、1980年から1990年にかけて第二期のブームが起きた。

また、ヤン・ルカン(Yann LeCun)らによって生物の低次の視覚野に相当する畳み込み層を導入した畳み込みニューラル・ネットワーク(Convolved Neural Network: CNN)の提案(1989)があった。

しかし、過学習を防ぐ理論もなく、また、学習に時間が掛かりすぎるなど課題が多くかったため、第二のブームも1990年には終わってしまった。

第3期(2006年から現在):

ジェフリー・ヒントン(Jeoffrey E. Hinton)やジョシュア・ベンジオ(Yoshua Bengio)らがDeep Neural Networkに事前学習とオートエンコーダを導入する手法を提案した(2006)。

2006年にNVIDIAがGPGPU用の並列計算フレームワークCUDA1.0を発表した。これを使用することで高速計算可能となり、処理時間の短縮化が可能となり、ディープ・ラーニングの環境整備が進展した。

2011年にサイデ(Seide)らが音声認識で成果を上げ、また、

2011年にクリゼスキー(Alex Krizhesky)らがReLU関数(ランプ関数)を提案し画像認識の世界的コンテストILSVRC2012において圧倒的性能を示した。

これにより、デープ・ラーニングがニューラルネットワークの従来手法を押しのけて主役になった。ディープ、2016年にはDeepMind社のAlphaGoが囲碁の世界王者イ・セドルに圧勝し、世の中に衝撃与え、一般の人々に人工知能の基本原理であるデープ・ラーニングという言葉を広めた。

計算機械学会(ACM:Association for Computing Machinery)は2018年度のチューリング賞受賞者を、カナダのモントリオール大学教授ヨシュア・ベンジオ氏(55)、カナダのトロント大学教授で、米国Googleのエンジニアリングフェローも務めるジェフリー・ヒントン博士(71)、米ニューヨーク大学教授で米FacebookのAIラボ所長でもあるヤン・ルカン博士(58)の3人に授与した。これにより、彼ら3人は「ディープ・ラーニング革命の父たち」として高い評価を受けた。

現在の機械学習におけるディープ・ラーニング研究は、これまでの2回の機械学習研究ブームとは次の2点で本質的な違いがある。第1の違いはGPUなどのハードウェア技術の進展であり、これにより100層を超える深いニューラルネットワークを扱うことが可能になっていることである。また、第2の違いは計算機環境の変化であり、インターネットの普及による大量の学習データ利用が可能となり、過学習の弊害も抑制可能となったことである。

既にディープ・ラーニングは人間の介在無しに、大量のデータから自律的に特徴量抽出を行い、難しい認識問題においてトップレベルの成果を上げている。人間が知識を獲得する仕組みをデープ・ラーニングはほぼ実現しており、今後も人工知能分野で研究成果を上げ続けて行くと思われる。

参考文献:

イラストで学ぶディープラーニング改訂第2班、第2章

山下隆義、講談社